Avec « 4o Image generation », OpenAI nous remet (enfin) une claque

Publié le 27 mars 2025

Écouter une version audio de cet article

ChatGPT vient de lancer son nouveau générateur d’images : « GPT4o Image generation ». Alors certes nous sommes souvent habitués aux lancements décevants d’OpenAI tels que Sora ou ChatGPT 4.5 qui ne sont pas de grandes réussites. Mais là, ne faisons pas les pisse-froid: bien que le modèle soit encore perfectible, il est réellement très prometteur et on va vous expliquer pourquoi. Comme d’habitude, cet article s’appuie sur plusieurs heures de tests, pas seulement après vu les vidéos promotionnelles d’OpenAI ou trouvé quelques tests à droites à gauche…

Pour ChatGPT, Dall-e 3 est mort et c’est tant mieux !

Depuis l’apparition des premiers systèmes de génération d’images par IA, OpenAI a régulièrement peaufiné ses modèles, sans pour autant être particulièrement convaincaint. Avant l’arrivée de Dall-e 3, le prédécesseur Dall-e 2 avait néanmoins marqué les esprits en permettant de créer des images à partir d’une simple description textuelle. Le résultat était souvent décevant mais la technologie, novatrice à l’époque commençait à susciter l’intérêt.

Lorsque Dall-e 3 est arrivé, beaucoup espéraient un bond qualitatif spectaculaire. Les premiers retours étaient plutôt positifs sur le fait de pouvoir échanger directement avec le modèle dans ChatGPT en lançant un prompt au milieu d’une interaction. Malgré tout, cette version avait un certain nombre de limites : visuels manquants de réalisme, visages étranges, mains effrayantes, et perspectives pas toujours cohérentes. Les amateurs de photoréalisme regrettaient aussi le manque de “texture” et de relief, qui empêchait souvent de se croire devant une vraie photo. Bref, ce n’était vraiment, vraiment pas terrible.

Le concept d’un générateur d’images directement intégré à ChatGPT, bien qu’extrêmement pratique, devait donc être amélioré en profondeur. L’intérêt d’un tel outil n’est en effet pas seulement de créer des scènes amusantes ou des illustrations au hasard : pour être vraiment utile, il faut qu’il puisse répondre à des besoins professionnels ou artistiques avec une certaine rigueur. Cela implique d’être capable de produire des compositions complexes, de rendre des détails avec précision et d’interpréter les consignes textuelles de manière fine.

OpenAI avait donc tout intérêt à proposer une mise à jour majeure, histoire de ne pas laisser les utilisateurs sur leur faim et de continuer à renforcer l’attrait de ChatGPT comme plateforme de création “tout‑en‑un”. Des rumeurs circulaient déjà depuis plusieurs mois sur l’idée d’exploiter les capacités de GPT‑4 pour offrir un modèle de génération d’images plus puissant, plus riche en connaissances et plus sensible aux nuances de langage. Avec cette nouvelle version, OpenAI veut donc combler le retard sur ces concurrents tels que Grok, Gemini ou Mistral et hisser la génération d’images au niveau qu’on attend d’un outil vraiment professionnel.

Une technologie multimodale qui mise sur la conversation

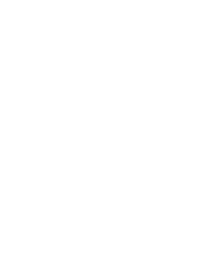

Cette nouvelle mouture mise sur un concept clé : un entraînement qui englobe simultanément texte et image, au lieu de se concentrer sur l’un ou l’autre. Autrement dit, GPT‑4o “comprend” à la fois les légendes descriptives, la structure linguistique et les caractéristiques visuelles qu’il doit générer. Là où ses prédécesseurs comme Dall-e 3 avaient déjà fait un pas vers la précision contextuelle, GPT‑4o pousse plus loin l’idée en restant dans un environnement où le texte n’est pas juste un prompt isolé, mais bien un échange continu.

Concrètement, on peut formuler un premier brief : “Fais-moi une affiche vintage pour un café bio en centre-ville, avec des teintes sépia et un slogan en haut de l’image”. L’IA produit alors un visuel. Ensuite, si on constate que la couleur du texte n’est pas assez lisible ou qu’on veut ajouter une petite illustration de tasse de café au milieu, on le lui dit directement. GPT‑4o, grâce à son modèle multimodal, comprend les références et retouche en tenant compte du contexte accumulé.

C’est ce qu’on appelle la “conversation multi-tour” : on n’est pas obligé de tout décrire en une fois ; on peut revenir plusieurs fois à la charge. Le modèle se souvient de ce qu’il a fait, il sait qui sont les personnages qu’il a déjà dessinés, quelles couleurs ont été utilisées, et peut même réutiliser des éléments d’un prompt précédent.

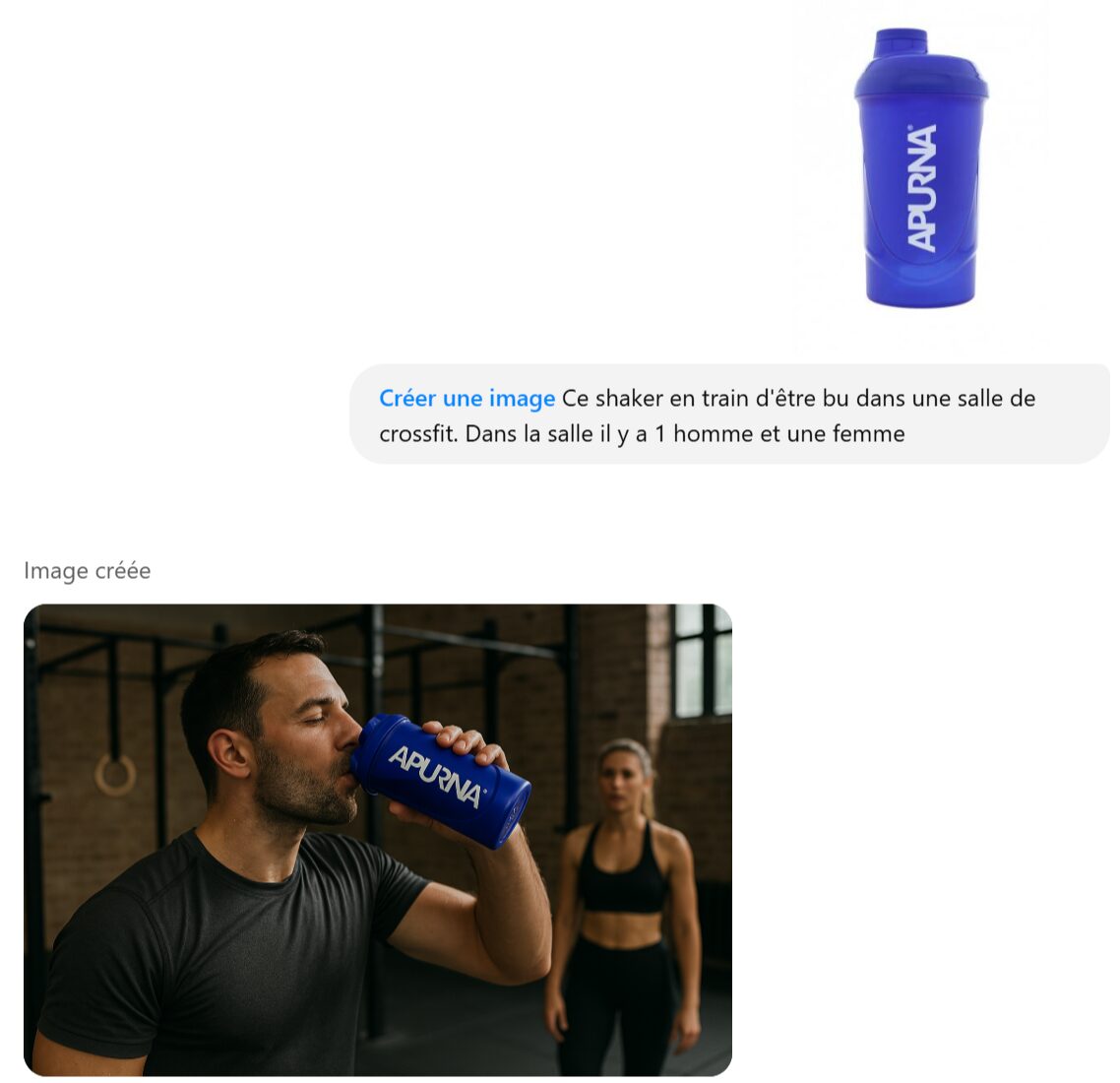

Mieux encore, sa base de connaissances encyclopédiques entre en jeu : on peut citer des lieux, des œuvres, des styles artistiques, et GPT‑4o va tenter de les reproduire ou de s’en inspirer. Dans un usage éducatif, on peut lui demander de “transformer le schéma de Newton sur le prisme en illustration enfantine avec des bulles de texte explicatives”, et il essaiera de nous livrer quelque chose de suffisamment clair et lisible pour un jeune public. Certes, cela reste parfois imparfait ou approximatif, mais on a clairement dépassé le stade où les images issues de l’IA étaient juste de jolies curiosités.

Ce n’est pas parfait (loin de là), mais c’est très prometteur

Le premier gros avantage de GPT‑4o, c’est que tout le monde peut s’y mettre immédiatement. C’est un peu l’“IA clé en main” : on ouvre ChatGPT, on commence à taper un prompt en français, on obtient un visuel à retravailler, et on continue à peaufiner. Sur ce point, c’est beaucoup plus ergonomique que de passer par un serveur Discord façon Midjourney, où il faut déjà savoir quels slash-commands taper (ok, j’exagère car depuis plusieurs mois ce n’est plus le cas), ou que d’aller sur un autre site pour utiliser Dall-e avec des prompts complexes. Et puis, GPT‑4o gère beaucoup mieux le texte dans l’image : finis (ou presque) les lettrages déformés et incompréhensibles, c’est plus cohérent pour créer des affiches, des menus ou des panneaux signalétiques. Mais soyons honnêtes : ce n’est pas encore parfait, loin de là ! Mais on avance.

En outre, sa puissance encyclopédique se ressent quand on veut donner un contexte culturel ou historique : il sait réutiliser des références, intégrer des détails liés à une époque ou à un lieu précis, ce qui peut être crucial pour la création de visuels documentaires ou pédagogiques.

Cependant, il n’est pas encore parfait et on le voit clairement. D’abord, la qualité artistique pure n’est pas toujours au niveau de Midjourney, qui reste la référence incontestée pour les rendus “wow”. Les textures ultra-réalistes, les lumières chatoyantes ou les détails complexes peuvent parfois être moins aboutis dans GPT‑4o.

En plus, il a cette manie de rognage, où il coupe un petit bout en bas ou sur les côtés, surtout sur des formats longs ou des visuels très chargés. Il peut aussi halluciner des objets ou en modifier d’autres alors qu’on ne lui a rien demandé. Parfois, quand on dépasse 10 ou 15 éléments distincts dans le prompt, il se met à confondre les couleurs, les positions, voire à inventer de nouveaux objets. Difficile aussi de lui faire rendre des textes non latins (japonais, chinois, russe) sans erreurs: ça peut devenir un joyeux bazar de caractères inexacts.

Et la retouche sélective demeure aléatoire : dire “change seulement la couleur du t-shirt” peut aboutir à des modifications sur la coiffure, le décor, ou encore d’autres détails non sollicités. Bref, même s’il y a un gain énorme en souplesse par rapport aux générations d’images précédentes, on ne peut pas encore se reposer aveuglément sur GPT‑4o pour tout ce qui requiert une précision chirurgicale ou un esthétisme haut de gamme.

Copilot conserve Dall-e : indice d’un éloignement entre Microsoft et OpenAI ?

Au-delà de la réussite technique, un point alimente les spéculations : Copilot, le projet phare de Microsoft pour assister les utilisateurs dans différents produits (GitHub Copilot pour coder, ou Copilot pour la suite Office, etc.), conserve son partenariat avec Dall-e pour générer des visuels.

On aurait pu s’attendre à un déploiement direct de GPT‑4o, histoire de bénéficier immédiatement de cette technologie plus récente et plus multimodale. Mais rien ne bouge officiellement, et Bing Image Creator demeure également arrimé à Dall-e. Cela soulève la question : est-ce que Microsoft et OpenAI s’éloignent progressivement sur certains pans stratégiques, malgré l’énorme investissement financier de Microsoft dans OpenAI ?

Une hypothèse, c’est que Microsoft veut rester prudent. Dall-e, déjà éprouvé, est un choix jugé plus stable pour ses produits grand public ou professionnels.

Autre scénario : Microsoft a des exigences particulières (performances, coûts, intégration) qui ne sont pas totalement remplies par GPT‑4o à ce stade.

Ou plus politique encore, Microsoft pourrait simplement ne pas vouloir dépendre à 100% de la roadmap d’OpenAI, préférant consolider ses propres briques technologiques et maintenir une forme d’indépendance.

Quoi qu’il en soit, ça crée une impression de puzzle, avec d’un côté GPT‑4o qui propulse ChatGPT, de l’autre Dalll-e qui reste le moteur officiel d’images pour Microsoft. On sent que, malgré leur alliance, les deux entités ont leurs priorités respectives. Pour les utilisateurs, cela se traduit par un choix : faut-il aller sur Copilot ou Bing Image Creator, ou se tourner vers GPT‑4o dans ChatGPT ? On dirait qu’ils ne veulent pas (encore) d’un écosystème unifié, et chacun guette peut-être la réaction du public avant de bouger davantage ses pions.

Formations IA générative

Explorez les origines de l’IA, ses enjeux éthiques et apprenez à interagir avec les IA génératives pour en tirer le meilleur parti. Cette formation exclusive vous offre la possibilité de progresser dans un secteur technologique en plein essor.

La sécurité et l’éthique en question

Dernier point qu’on ne peut pas éluder : la sécurité, la modération et l’usage éthique de ces images générées. OpenAI met en avant son mécanisme de filtrage et de détection pour empêcher les contenus illicites ou trop sensibles : tout prompt tendancieux est censé être refusé, et chaque image fabriquée par GPT‑4o est censée contenir des métadonnées (C2PA) pour signaler qu’il s’agit d’une création IA. L’idée est d’éviter que des deepfakes trop crédibles inondent la toile sans qu’on puisse en retracer l’origine.

En théorie, c’est un pas dans la bonne direction, mais en pratique, on sait tous qu’il y aura toujours des failles, surtout quand des utilisateurs ingénieux chercheront à contourner les règles.

L’autre volet, c’est la question de la gouvernance de cette technologie : à mesure que GPT‑4o s’impose dans le paysage, comment s’assurer qu’il n’alimente pas la désinformation, qu’il ne crée pas de stéréotypes ou de biais ? OpenAI prétend employer un “reasoning LLM” spécialisé dans la vérification des prompts, mais on sait que la ligne est mince entre la modération nécessaire et un filtrage trop restrictif qui tuerait la liberté créative.

On peut aussi se demander ce qui se passera quand le modèle sera accessible à toutes sortes de développeurs via une future API. Plus il y a d’applications tierces, plus le risque d’abus grandit, et plus la tâche de régulation devient difficile. On retombe sur le vieux débat : faut-il ouvrir la boîte de Pandore et compter sur la responsabilité collective, ou verrouiller le système en sacrifiant la liberté des utilisateurs ?

OpenAI parle d’adaptations et de mises à jour en continu, comme si la modération allait être un chantier permanent. C’est sans doute inévitable : à chaque innovation, on a besoin d’un suivi technique pour éviter les dérives. Reste à savoir si ces solutions, basées sur des règles internes et sur les avancées de l’IA elle-même, suffiront à empêcher des scandales ou des usages malveillants de GPT‑4o, notamment quand l’outil sera de plus en plus performant et généralisé.

Grégory JEANDOT

Consultant sr et Formateur IA

Avec un langage simple (et non simpliste), Grégory décrypte l’univers de l’IA générative. Pas de sémantique complexe ou d’approche trop verbeuse : l’objectif est de faire monter tout le monde en compétence !

![[Étude] L’IA fait gagner 1 jour par semaine aux chefs de projet. Vraiment ?](https://tous-les-jeudis.fr/wp-content/uploads/2025/11/tous-les-jeudis-formation-ia-gestion-de-projet-gain-de-temps.jpeg)